Ollama: Uruchamiaj modele językowe lokalnie z łatwością

Ollama to narzędzie open source zaprojektowane dla systemu Windows, które umożliwia użytkownikom uruchamianie dowolnego modelu językowego na ich lokalnej maszynie. Wykorzystując moc obliczeniową komputera, to narzędzie ułatwia generowanie odpowiedzi bez polegania na internetowym LLM. Nawet przy ograniczonych zasobach, Ollama zapewnia spójne odpowiedzi, chociaż wolniejsze przy nieefektywnym sprzęcie.

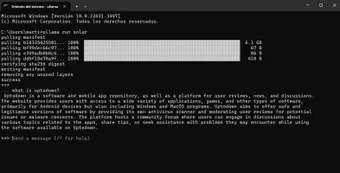

Instalacja różnych modeli, takich jak Llama 3, Phi 3, Mistral czy Gemma, jest prosta z Ollama. Wprowadzając konkretne polecenia, takie jak 'ollama run llama3' w konsoli, możesz rozpocząć proces instalacji. Ollama prowadzi rozmowy przez Windows CMD domyślnie i zaleca posiadanie podwójnej ilości wolnego miejsca na dysku w porównaniu do rozmiaru każdego dodanego LLM dla optymalnej wydajności.